Bildgeneratoren der Künstlichen Intelligenz wie Midjourney, DALL-E, Movie Gen AI, Adobe Firefly, Sora oder auch Stable Diffusion erfreuen sich bereits großer Beliebtheit und auch die Video/Bewegtbildgeneratoren erobern sich langsam, aber sicher ihre Märkte. Selbst auf Filmfestivals werden inzwischen eigene Sektionen für KI-Filme vorsichtig eingerichtet. Das liegt auch daran, dass die Hersteller sie nicht nur in Form hochpreisiger Angebote für Spezialisten, Studios, Agenturen etc. vermarkten, sondern auch niedrigschwellig, teilweise sogar kostenlos praktisch Jedermann zur Verfügung stellen. Dies tun sie allerdings nicht aus Generösität und sozialem Gerechtigkeitssinn, sondern weil sie indirekt deutlich davon profitieren und die User für ihre Bezahlversionen begeistern möchten. Doch dazu kommen wir noch.

Konsistenz

Werden Bilder oder ganze Filme mit der KI generiert, sind die Ergebnisse meist zufällig. Wie schwer ist es, der KI so etwas wie Konstanz und Verlässlichkeit beizubringen? Wer mit der KI Bilder generiert merkt schnell, die Generatoren bieten ständig andere Lösungen an, jeder neue Versuch ist eine Wundertüte, die sich nur schwer beherrschen lässt. Der gleiche Prompt (Textzeile als Eingabebefehl) zum Beispiel mit der Aufforderung "einen jungen Mann mit dunklen Haaren zur Seite schauen zu lassen", erzeugt bei jedem neuen Renderauftrag andere Gesichter.

Wenn man nur ein einzelnes Foto benötigt, dann kann das völlig ausreichen. Benötigt man aber viele Bilder, dann wird es richtig schwierig, hier ein und dieselbe Person in unterschiedlichen Ansichten und Positionen generiert zu bekommen. Und wenn es sogar 25 Bilder in der Sekunde sein müssen, wie beim Film, dann wird es richtig hart. Durchgehende längere filmische Sequenzen oder ganze Filme mit konstanten Örtlichkeiten und Personen zu generieren, gelingt aktuell noch nicht wirklich überzeugend. Dieses Problem gibt es natürlich nicht nur bei der Generierung von Bildern und Filmsequenzen. Die führenden Anbieter von KI-Modellen arbeiten alle an Verfahren, die der KI ein Gedächtnis verleihen sollen. Doch es werden sicherlich zunächst einmal die Chatbots sein, die dann von solchen, vermutlich zwischen User und Ki-Modell geschalteten Algorithmen profitieren werden.

Auch ist die Qualität der Aufnahmen höchst unterschiedlich und natürlich gibt es hier und da auch Artefakte wie die Hand mit fünf Fingern, aber ohne Daumen.Es gibt einfach bestimmte Bildelemente, bei denen es der KI schwerer fällt, saubere Ergebnisse zu liefern. So gehören insbesondere Hände, Ohren oder Zähne zu den fehleranfälligen Bereichen, wenn möglich sollte man diese vermeiden. Auch die generierten Augen können sehr künstlich wirken, oft übergroß wie bei Anime Figuren, verschwommen sein oder sie haben sogar unterschiedliche Farben.

Generative Bildgebende KI

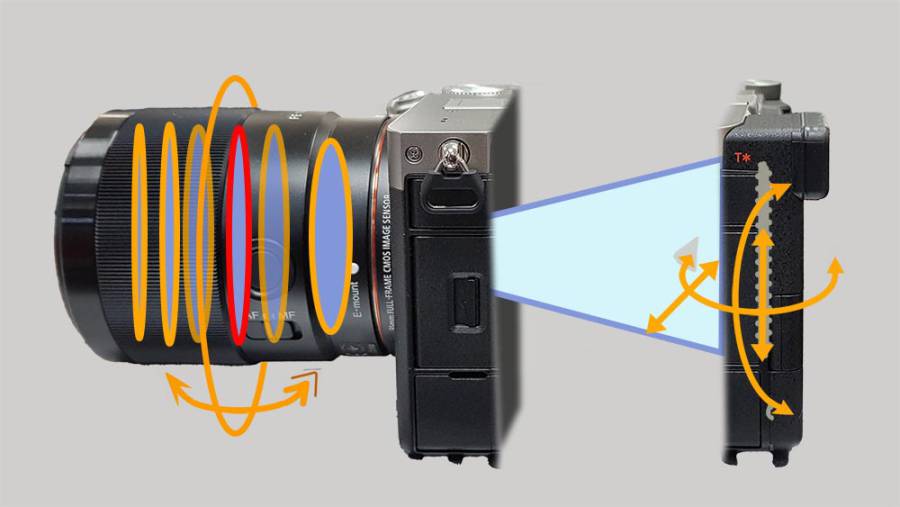

Um zu verstehen, wie solche Probleme entstehen, muss man sich genauer anschauen, die die KI das eigentlich bewerkstelligt, Bilder und Videos zu erzeugen. Grundsätzlich muss einem klar sein, dass Künstliche Intelligenz keine Augen besitzt. Sie muss also Bilder analysieren und von uns Menschen mitgeteilt bekommen, was genau sie da analysiert hat, wir sprechen dabei von maschinellem Lernen. Dadurch bekommen Formen, Muster, Farben, Strukturen etc. in den Bildern und Videos in Kombination mit von Menschen eingegebenen Texten, Beschreibungen und Kategorisierungen eine Beschreibung und Bedeutung. Das geschieht durch sogenannte Lage Language Modelle (LLM) kombiniert mit Diffusionsmodellen. Während die LLMs für das Lernen, das Erkennen und die Begrifflichkeiten zuständig sind, verwandeln die Diffusionsmodelle konkrete Bilder in, wie der Name schon sagt, diffuse, nicht mehr konkrete Dateien, die man als Bildrauschen bezeichnen könnte. Beim Generieren dann werden daraus, im schrittweisen Abgleich mit Bildbeispielen aus der Datenbank, Teile wieder in konkrete Bilder zurückverwandelt.

Dieses Zurückverwandeln oder nennen wir es Generieren neuer Bilder, passiert durch zahllose Abgleiche mit den eingegebenen Prompts (Textbefehlen) welche wiederrum mit all den gelernten, antrainierten und mit Bedeutung versehenen Bildern immer weiter optimiert werden. Je breiter die Datenbasis ist und je mehr Zusammenhänge die KI gelernt hat, desto besser werden die Ergebnisse. Dennoch geben die KI Generatoren meistens mehrere Varianten zur Auswahl aus, welche wir User wieder per Rückmeldung und Erweiterung oder Veränderung des Prompts optimieren können. Oder aber wir lassen die Bilder komplett neu generieren, wenn die Auswahlergebnisse allzu weit von dem gewünschten Resultat entfernt waren. Besonders interessant sind hier die Korrekturen, welche sich lediglich auf die Bildelemente beziehen, welche noch nicht passen, während die übrigen, stimmigen Bildteile unverändert bleiben können.

In allen solchen Fällen sind wir nicht nur Kunden und Anwender der KI, sondern wir sind praktisch auch unbezahlte Mitarbeiter für die Anbieter der Bildgeneratoren, denn mit unseren Prompts und Korrekturen trainieren wir zugleich die Systeme.

Bessere Prompts

Tatsächlich kann man sehr viel Zeit damit verlieren, immer wieder neue Vorschläge der KI zu prüfen, zu verwerfen und auf bessere Varianten zu hoffen. Häufig sehen die generierten Gesichter oder Menschen aus wie aus einem Werbe-Shooting oder sie stammen aus gänzlich anderen Kulturkreisen und passen einfach nicht in die gewünschte Situation. Man spart viel Zeit, wenn man sich angewöhnt, möglichst genaue Beschreibungen dessen, was man sich vorstellt, einzugeben.

- Zunächst sollte man den Prompt mit dem Arbeitsauftrag beginnen, also zum Beispiel "Erzeuge ein Bild / Video von..." oder "Erstelle eine Abbildung / Szene von..."

- Die KI arbeitet besser, wenn man in seinem Prompt gut strukturiert beschreibt. Algorithmen mögen klare Strukturen, was visuell zusammengehört, sollte auch im Text zusammenhängend beschrieben werden.

- Es erhöht die Chance auf gute Ergebnisse, wenn man im Prompt auch angibt, wo man sich welche Elemente wünscht, sowohl von der räumlichen Positionierung in der Horizontalen und der Vertikalen, als auch was vorne und was hinten sein soll.

- Gute Prompts können manchmal ganze Seiten lang sein, doch das sind dann schon sehr spezielle Dinge, meist genügen ein oder mehrere genaue Textzeilen um dem gewünschten Ziel näher zu kommen.

- Man darf ruhig seine visuelle Fantasie in Worte fassen. Beispielsweise: Detailliertes Bild von drei jungen Personen, die vor einem Hochhaus stehen nach oben schauen. Hinter dem Hochhaus geht die Sonne unter und wirft lange Schatten auf das Straßenpflaster vor dem Gebäude.

Um es mit einem Beispiel zu erläutern:

Wenn man nur eingibt: "freundlicher Mann sitzend" dann wird das Ergebnis vermutlich bei weitem nicht das treffen, was man sich vorstellt.

Wie alt ist der Mann? Welche Haarfarbe hat er? Welche Frisur? Ist er Brillenträger? Trägt er ein T-Shirt oder ein Jackett? In welchen Farben? Sitzt er an einem Tisch, einer Bank, auf einem Hocker?

Ausschlusskriterien

Es neigen viele Generatoren dazu, in die generierten Bilder weitere Elemente zu integrieren, die man nicht haben möchte. Der Klassiker beim Generieren von Menschen sind Brillen. Oder weitere Menschen oder Fahrzeuge oder Tiere. Das kann man vermeiden, indem man diese Elemente bereits im Prompt ausschließt. "Keine Brille", "Keine Tiere", "Keine Autos" oder manchmal versteht die KI auch Enlisch besser und man wird die ungewünschten Bildelemente mit einem "no animals" los.

Wenn man mehrere Menschen im Bild sehen möchte, hilft es, der KI die Anzahl der Menschen zu nennen, sonst neigen einige Modelle dazu, möglichst viele Menschen in das Bild zu quetschen.

Stilfragen

Will man ganze Bilder und nicht nur Teile generieren lassen, ist es auch wichtig, den Stil zu definieren. Realistisch, Surreal, Hyperrealistisch, Digital Art, Fantasy Art sind nur ein paar Beispiele. Ebenso wichtig ist es die gewünschten Lichtverhältnisse oder die Tageszeit vorzugeben.

Es gilt die Regel, je präziser man das Gewünschte beschreibt, desto höher sind die Chancen auf ein gutes Ergebnis. Manche der Generatoren erkennen keine Umlaute, kennen also nur die Buchstaben der englischsprachigen Tastatur, sie akzeptieren aber die üblichen Workarounds, also ä, ö, ü durch ae, oe, ue zu ersetzen. Oder man gibt seine Prompts gleich auf Englisch ein.

Rechtefrei?

Nach wie vor herrscht in der Welt der meisten Bildgeneratoren Wildwest Mentalität. Die Schutzbehauptung, man sei der Ansicht, dass alle im Internet verfügbaren Bilder und Videos auch als "Public Domain" frei verwendet werden dürfen, führt immer öfter in Gerichtsverfahren zu Schadenersatzforderungen. Einzig Adobe verspricht, dass nur Bildmaterial als Basis verwendet wird, an dem Adobe auch die Urheber,- und Nutzungsrechte besitzt oder welches offen lizenziert und als gemeinfrei gekennzeichnet und nicht urheberrechtlich geschützt ist.